A Meta anunciou na segunda-feira que tomará medidas adicionais para reprimir o compartilhamento de contas de conteúdo “não original” para o Facebook, o que significa que reutilizam repetidamente o texto, as fotos ou os vídeos de outra pessoa. Este ano, a Meta já retirou cerca de 10 milhões de perfis que se passavam por grandes criadores de conteúdo, disse.

Além disso, tomou medidas contra 500.000 contas que estavam envolvidas em “comportamento de spam ou engajamento falso”. Essas ações incluíram coisas como rebaixar os comentários das contas e reduzir a distribuição de seu conteúdo para evitar que as contas monetizem.

A atualização da Meta segue apenas alguns dias depois que o YouTube disse que também estava esclarecendo sua política em torno de conteúdo não original, incluindo vídeos produzidos em massa e repetitivos – coisas que se tornaram mais fáceis de gerar com a ajuda da tecnologia de IA.

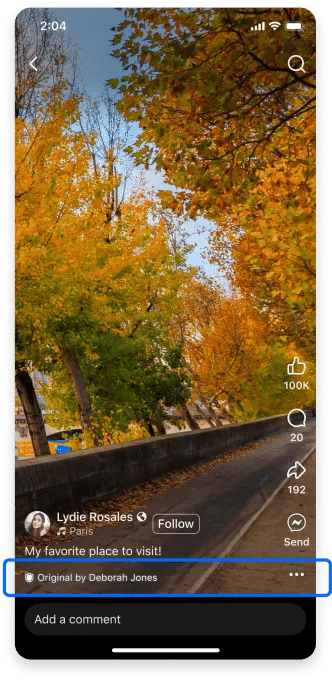

Como o YouTube, a Meta diz que não penalizará os usuários que estão interagindo com o conteúdo de outras pessoas, fazendo coisas como fazer vídeos de reação, participar de uma tendência ou adicionar suas próprias tomadas. Em vez disso, o foco do Meta é a republicação do conteúdo de outras pessoas, seja em contas de spam ou aquelas que fingem pertencer ao criador original.

As contas que abusam do sistema reutilizando repetidamente o conteúdo de outra pessoa perderão o acesso aos programas de monetização do Facebook por um período de tempo e verão a distribuição reduzida de suas postagens, disse a empresa. Quando o Facebook detecta vídeos duplicados, também reduzirá a distribuição das cópias para garantir que o criador original receba as visualizações e o crédito.

Além disso, a empresa disse que está testando um sistema que adiciona links em vídeos duplicados que apontam os espectadores para o conteúdo original.

Embora a mais nova repressão da Meta esteja focada mais em contas que roubam o lucro do conteúdo de outras pessoas, as questões em torno do conteúdo não original estão crescendo.

Com o surgimento da tecnologia de IA, as plataformas foram inundadas com o slop da IA, um termo referenciando conteúdo de mídia de baixa qualidade feito usando IA generativa. No YouTube, por exemplo, é fácil encontrar uma voz de IA sobreposta em fotos, videoclipes ou outro conteúdo reaproveitado, graças a ferramentas de IA de texto para vídeo.

A atualização do Meta aparentemente se concentra apenas no conteúdo reutilizado, mas seu post sugere que ele também pode estar levando em consideração a IA. Em uma seção em que a empresa oferece “dicas” para fazer conteúdo original, a Meta observa que os criadores não devem apenas “cometer clipes” ou adicionar sua marca d’água ao usar conteúdo de outras fontes, e eles devem se concentrar em “contagência autêntica”, não em vídeos curtos que oferecem pouco valor.

Sem dizer isso diretamente, esses tipos de vídeos não originais também são coisas que as ferramentas de IA tornaram mais fácil de produzir, já que vídeos de baixa qualidade geralmente apresentam uma série de apenas imagens ou clipes (reais ou AI), com narração de IA adicionada.

No post, o Meta também adverte os criadores a não reutilizar conteúdo de outros aplicativos ou fontes, o que tem sido uma regra de longa data. Ele também observa que as legendas de vídeo devem ser de alta qualidade, o que pode significar reduzir o uso de legendas automatizadas de IA que não são editadas pelo criador.

Meta diz que essas mudanças serão lançadas gradualmente nos próximos meses, de modo que os criadores do Facebook têm tempo para se ajustar. Se os criadores acharem que seu conteúdo não está sendo distribuído, eles podem visualizar os novos insights pós-nível no Painel Profissional do Facebook para entender o porquê.

Os criadores também poderão ver se estão em risco de recomendação de conteúdo ou penalidades de monetização na tela inicial do Suporte a partir do menu principal da Página ou do perfil profissional.

A Meta normalmente compartilha informações sobre suas quedas de conteúdo em seus Relatórios de Transparência trimestrais. No último trimestre, a Meta disse que 3% de seus usuários ativos mensais em todo o mundo no Facebook eram contas falsas e que havia tomado medidas em 1 bilhão de contas falsas de janeiro a março de 2025.

Mais recentemente, a Meta se afastou da verificação de fatos em seu próprio conteúdo em favor das Notas da Comunidade nos EUA, semelhante ao X, que permite que usuários e colaboradores determinem se as postagens seguem os Padrões da Comunidade da Meta e são precisas.

fonte: Techcrunch